구글의 서비스가 이용자 의도를 보다 잘 이해하는 방향으로 진화한다. AI 음성비서 서비스 ‘구글어시스턴트'는 인간의 언어습관을 섬세하게 인식할 수 있도록 업데이트 됐다. 이미지·텍스트 통합 검색 도구 ‘멀티서치'는 검색을 통해 제공할 수 있는 정보를 극대화하고 검색 편의를 강화했다.

구글어시스턴트 "헤이구글" 부르지 않아도 실행·이용자 언어습관까지 파악

구글의 대화형 AI 음성비서 서비스 ‘구글 어시스턴트'는 더욱 똑똑해진다. 마치 사람처럼 자연스럽게 대화할 수 있는 기능으로 업데이트했다. 구글 어시스턴트는 구글이 개발한 AI 가상 비서로, 사람의 언어를 인식하고 분석해 이용자의 명령에 적합한 답변을 제공하는 서비스다.

그동안 구글어시스턴트는 이용자가 ‘헤이구글'이라는 명령어를 부르거나, 앱 실행을 해야 서비스를 이용할 수 있었다. 앞으로는 이런 과정이 필요 없어진다. 구글은 이용자의 ‘시선’을 인식해 구글 어시스턴트를 실행하는 ‘룩 앤 톡(Look and Talk)’ 서비스를 제공한다.

이는 구글이 카메라를 통해 100개 이상의 시선 신호를 분석하는 기술을 어시스턴트에 녹였기 때문이다. 어시스턴트 실행을 의도한 시선과 그렇지 않은 시선 등을 구분할 수 있는 능력을 갖춘 것이다. 이에 AI비서와 이용자 간 유연하고 자연스러운 대화가 가능해지게 됐다.

이용자 언어를 섬세하게 인식하는 기능도 업그레이드했다. 이용자마다 다른 언어 스타일이나 습관을 상황에 맞게 해석, 명령을 수행한다. 예를 들어 "불을 켜라" 혹은 "불!"이라는 명령을 들은 구글 어시스턴트는 맥락을 분석해 거실에 불을 켜는 동작을 실행한다.

또 대화에서 발생하는 ‘머뭇거림'을 인식해, 명령을 기다려줄 수 있는 ‘스피치 모드(Speech modes)’도 장착했다. 이용자의 "음… 어…" 같이 말을 다듬는 뉘앙스를 파악해 질문이 끝날 때까지 기다린다. 구글은 해당 기능을 안드로이드에 먼저 적용하고, 5월 중순 iOS에도 서비스할 계획이다.

더 똑똑해진 구글맵스…멀티서치는 더욱 강화

구글맵스가 제공하는 장소 정보도 풍부해 진다. 이용자가 장소에 마치 방문한 것처럼 실내외를 포괄한 정보를 생생하게 제공할 계획이다. 예를 들어 특정 음식점에 방문하고 싶은 이용자가 구글맵스에 접속하면, 마치 해당 공간에 방문한 것처럼 3D로 구축된 입체적 공간 정보를 볼 수 있다. 이같은 3D 공간정보는 올해말까지 LA, 뉴욕, 런던부터 서비스될 예정이다.

미리엄 대니얼 구글 맵스/GEO 컨슈머부서 VP는 "시간의 흐름이나 날씨에 따라 변화하는 장소 정보까지 생생하게 체감할 수 있도록 구현하겠다"고 설명했다.

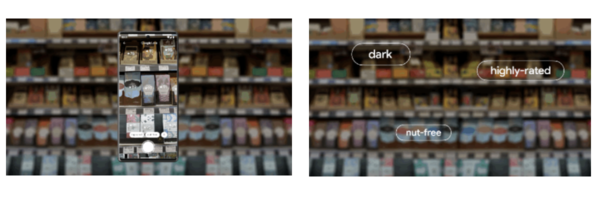

검색 편의성을 위해 제공되던 ‘멀티서치' 기능도 강화된다. 멀티서치는 이용자가 구글의 이미지 인식 기술인 ‘구글 렌즈’를 통해 이미지를 검색에 활용할 수 있도록 돕는 서비스다.

구글은 멀티서치에 인근 상점이나 음식점 정보를 편리하게 제공하는 ‘니어 미(Near Me)’ 기능을 추가한다. 검색어나 검색 이미지와 함께 ‘니어 미' 라는 텍스트를 입력하면, 이를 구매할 수 있는 인근 상점 정보를 제공한다.

예컨대 음식 블로그에서 ‘잡채' 사진을 캡처해, 구글렌즈로 검색하면 인근에서 ‘잡채'를 판매하는 식당 정보까지 제공한다. 또 ‘구글맵스'와 연계해 가게의 위치는 물론, 이용자들의 후기들도 함께 파악할 수 있다. 구글은 올해 말까지 ‘니어 미'의 영어 서비스를 먼저 제공하고, 향후 다른 언어들을 추가한다는 계획이다.

닉 벨(Nick Bell) 구글 프로덕트 매니지먼트 시니어 디렉터는 "장면탐색 기능은 혁신이다. 단순한 시각 정보 인식을 넘어, 주변의 맥락 정보까지 분석할 수 있는 능력이 있어야 하기 때문이다"이라면서 "아직 이 기능은 공식 론칭하지는 않았고 개발중이지만, 향후 어느 장소에서든 장면탐색 서비스를 이용할 수 있도록 할 계획이다"라고 설명했다.

구글은 이용자 프라이버시 강화를 위한 새로운 정책도 발표했다. 앞으로 구글은 이용자 결제 정보를 보호하기 위해 ‘버츄얼 카드'를 선보인다. 버추얼 카드는 이용자가 자신의 실물 카드 번호를 입력하지 않고도 결제를 가능케하는 시스템이다. 앞으로 이용자는 카드 정보와 같은 민감한 개인정보를 가맹점에 제공하지 않고도 온라인 쇼핑을 할 수 있다. 구글은 올해 여름부터 미국을 시작으로 ‘버추얼 카드'를 도입할 계획이다. 이를 위해 비자, 아메리칸 익스프레스 같은 미국 내 주요 금융기관과 협력한다.

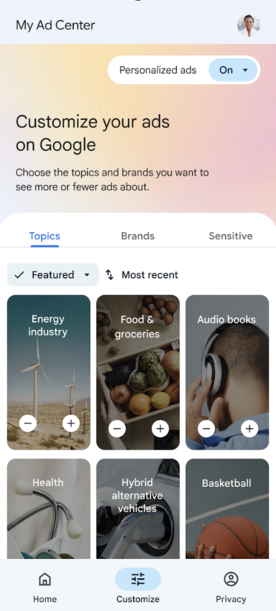

‘맞춤형 광고'의 이용자 선택권도 강화한다. 이용자에게 보다 많은 통제권을 주기 위해서다. 하반기부터 이용자는 구글 ‘마이애드센터'를 통해 자신이 보고 싶지 않은 광고의 종류를 선택해 차단할 수 있다. 마이애드센터에서 자신이 원치 않는 광고의 종류를 주제별, 브랜드별로 선택할 수 있다.

개인정보 삭제 정책도 업데이트한다. 이용자가 자신의 개인정보 데이터를 주도적으로 관리할 수 있도록 하기 위해서다. 만약 구글 검색 결과에 전화번호나 집주소, 이메일 주소 같은 ‘개인식별정보'가 노출된 이용자는 구글의 ‘나에 대한 검색 결과 확인하기(Results about you in Search)’를 이용해 자신의 정보 삭제를 요청할 수 있다. 구글은 검토를 거쳐 해당 정보를 삭제한다.

보안 기술 투자도 강화한다. 보안 기술 첨단화를 위해 5년간 100억달러를 투자한다. 이용자 정보를 지키기 위해선 해킹 방지 노력이 무엇보다 중요하다고 판단했기 때문이다. 또 이용자가 피싱과 같은 사이버 공격에 노출되지 않도록 여러 AI기반 보안 기술을 강화한다.

구글은 "프라이버시 보호의 기본은 보안이다"라며 "이용자 계정을 보호하기 위한 종합적인 프로세스를 제공하겠다"고 밝혔다.

이은주 기자 leeeunju@chosunbiz.com