인공지능(AI)을 활용해 가짜 뉴스를 만들어내는 시대다. 기술 고도화로 인해 이런 가짜뉴스를 판별하는 일은 더욱 어려워진다. 앞으로 어떻게 진실과 거짓을 구분해야 할까. 결국 답도 인공지능에 있다.

MIT테크놀로지리뷰는 26일(현지시각) 인공지능이 만든 텍스트를 탐지하는 인공지능을 하버드대와 MIT-IBM 왓슨 AI 랩 연구팀이 개발했다고 보도했다. 이들이 발표한 이름은 거대언어모델실험실(GLTR:Giant Language Model Test Room)이다. 이를 활용하면 가짜뉴스를 생성하는 인공지능에 대적할 수 있다.

지난 2월 가디언 등 외신은 비영리 인공지능 연구단체 ‘오픈AI(OpenAI)’가 가짜뉴스를 생성하는 인공지능 ‘GPT2’을 만들었다고 보도했다. 테슬라 설립자인 일론 머스크도 이 단체의 후원자다. 이들은 연구의 위험성 때문에 그 결과를 외부에 공개하지 않았다.

이를테면 브렉시트(Brexit)에 대한 사실 몇 줄을 넣으면, GPT2는 자동으로 이를 인식해 신문기사를 작성한다. 유명 인사의 인용문, 아일랜드 국경에 대한 언급, 그리고 총리 대변인의 대답도 기사에 담는다. 물론 이는 모두 가짜다. 해당 기사의 한 구절은 다음과 같다.

메이 총리의 대변인은 5월에 "수상(Prime Minister)은 최대한 빨리 유럽 연합을 떠나겠다는 여왕의 의도를 확실히 했다"며 "이는 지난 주 여왕이 연설에서 말했듯 그녀의 협상 권한에 따라 결정될 것이다"라고 밝혔다.

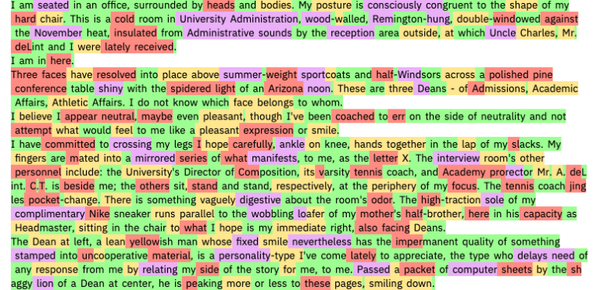

GLTR는 글에 사용한 단어를 통계적으로 분석한다. 한 단어 뒤에 다른 단어가 나올 확률을 계산하고, 색상으로 이를 표시한다. 가장 ‘예상대로’인 단어는 녹색이고, 예측 가능한 정도가 낮을수록 노란색, 빨간색으로 표시한다. 가장 예측할 수 없는 단어는 보라색이다.

연구팀이 인공지능(OpenAI)이 작성한 글로 테스트 했을 때, 예측 가능한 정도가 훨씬 더 높았다.

연구팀은 하버드 학생들에게 인공지능이 작성한 글을 판별해볼 것을 주문했다. 그들은 아무 도움 없이는 절반 정도의 가짜 뉴스를 알아챘다. 반면 GLTR의 도움을 받았을 때는 식별 정확도를 72% 정도까지 올릴 수 있었다.

MIT 테크놀로지 리뷰는 보도를 통해 "가짜 글과 이미지를 생성하는 기술이 빠르게 발전하고 있는 상황이다"라며 "GLTR같은 도구는 가짜 뉴스나 딥페이크(Deepfakes), 트위터 봇과의 싸움에서 중요한 무기가 될 것으로 본다"고 전했다.