"인공지능(AI)의 놀라운 발전을 지속하려면 인텔 너바나 뉴럴 네트워크 프로세서(NNP) 및 모비디우스 미리어드(Movidius Myriad) 비전 프로세싱 유닛(VPU)과 같은 전용 하드웨어가 필요하다."

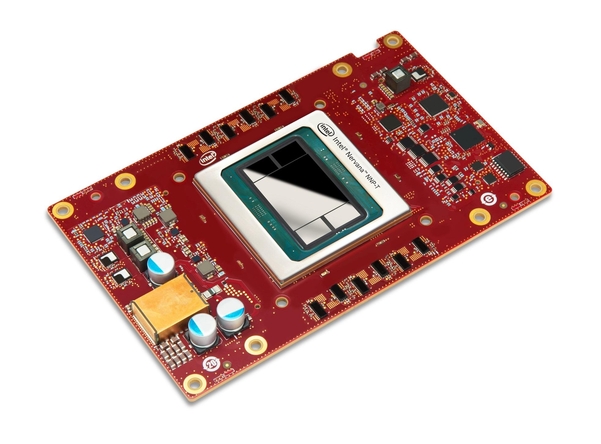

이날 시연한 인텔 NNP는 트레이닝(NNP-T1000)과 추론(NNP-I1000)을 위한 제품으로, 클라우드 및 데이터센터 고객을 위한 확장성과 효율성을 지원한다.

인텔의 AI 포트폴리오는 고객이 대규모 클라우드에서 소규모 엣지 디바이스까지 모든 규모에서 AI 모델을 개발하고 구현할 수 있도록 지원한다. 새로운 인텔 너바나 NNP는 개방형 구성 요소 및 딥 러닝 프레임 워크 통합으로 개발된 완전한 소프트웨어 스택을 제공한다.

인텔 너바나 NNP-T는 컴퓨팅, 통신, 메모리 간의 최적의 균형을 유지해 소규모 클러스터에서 최대 포드 슈퍼컴퓨터에 이르기까지 에너지 효율적인 확장성을 제공한다. 인텔 너바나 NNP-I는 다중 모드 추론을 실제 구현하는데 이상적이다. 두 제품 모두 바이두 및 페이스북과 같은 최첨단 AI 고객의 AI 처리 요구에 맞게 개발됐다.

차세대 인텔 모비디우스 VPU는 2020년 상반기에 출시될 예정이다. 이 제품은 이전 세대보다 10배 이상 높은 추론 성능을 제공할 것으로 예상된다. 인텔은 인텔 오픈 비노(OpenVINO) 툴킷 디스트리뷰선과 함께 엣지용 인텔 데브클라우드(DevCloud)를 발표했다. 이는 개발자들이 하드웨어를 구매하기 전에 광범위한 인텔 프로세서 기반에서 AI 솔루션을 시도해보고, 테스트하고 프로토타입화할 수 있도록 지원한다.

- 신학철 LG화학 부회장 "전기차 배터리는 제 2의 반도체…제패 위해 소·부·장 상생 강화"

- SK하이닉스 도쿄에 이미지센서 R&D 센터…반도체 사업 다각화 모색

- 日 반도체 전문기자 "韓 소재 자립까지 中 가만히 있겠나"

- "반도체 소재 국산화 성공 비결은 운 아닌 실력"

- 네이버, AI 반도체 스타트업 퓨리오사AI에 후속투자

- 서울반도체 3분기 영업익 57%↓ 120억원…재고·중국산 저가 공세

- 삼성 "1억화소 센서·5㎚·6세대 V낸드 등 반도체 기술 리더십으로 2020년 준비"

- 12회 반도체의 날…산·학·연 관계자 우려 속 '위기 돌파' 다짐

- 특허소송 '끝판왕' 이정훈 서울반도체 회장…그의 전쟁은 끝나지 않았다

- 삼성전자, 반도체·AI 등 미래기술에 330억 투자

- 삼성전자 최초 3D-TSV 개발…반도체 크기 그대로, 용량 1.5배↑