카카오는 경량 멀티모달 언어모델 ‘카나나-1.5-v-3b’와 MoE(Mixture of Experts) 언어모델 ‘카나나-1.5-15.7b-a3b’을 오픈소스로 공개했다고 24일 밝혔다.

이번 공개는 카카오가 5월 공개한 언어모델 카나나-1.5 4종에 이어 두 달 만에 추가 모델을 선보인 것이다. 김병학 카나나 성과리더는 “이번 오픈소스 공개는 비용 효율성과 성능이라는 유의미한 기술 개발 성과를 거둔 것이다”라며 “단순한 모델 아키텍처의 진보를 넘어 서비스 적용과 기술 자립이라는 두 가지 측면의 목표에 부합하는 결과물이다”라고 말했다.

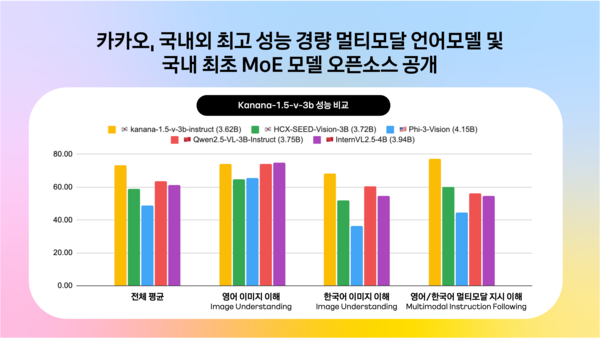

카나나-1.5-v-3b는 텍스트 뿐만 아니라 이미지 정보도 처리할 수 있는 멀티모달 언어모델로 ‘프롬 스크래치(From Scratch)’ 방식으로 개발됐다. 해당 모델은 이용자 질문 의도를 정확히 이해하는 지시 이행 성능과 한국어·영어 이미지 이해 능력을 보유했다.

카카오는 “이미지 및 글자 인식, 동화 및 시 창작, 국내 문화유산 및 관광지 인식, 도표 이해, 수학 문제풀이 등 여러 분야에서 유연하게 활용할 수 있다”라고 전했다.

MoE는 입력 데이터 처리 시 모든 파라미터가 연산에 참여하는 기존 모델과 달리 효율적인 컴퓨팅 자원 활용과 비용 절감을 갖췄다. MoE 아키텍처를 적용한 ‘카나나-1.5-15.7b-a3b’는 전체 15.7B의 파라미터 중 추론 시 약 3B 파라미터 활성화만으로 동작한다.

카카오는 하반기 중 에이전트형 AI 구현에 필수적인 추론 모델의 성과를 공개한다. 또 글로벌 플래그십 수준의 초거대 모델 개발에 도전해 국내 AI 생태계의 자립성과 기술 경쟁력 강화에 기여할 계획이다.

천선우 기자

swchun@chosunbiz.com