차세대 ‘AI PC’의 필수 요건인 NPU(신경망처리장치)의 기준이 한 단계 높아진다. 퀄컴이 차세대 AI PC를 위한 ‘스냅드래곤 X2 엘리트’ 시리즈 프로세서에 기존보다 78% 성능이 향상된 ’80TOPS(초당 80조회 연산) ’ NPU(신경망처리장치)를 탑재했기 때문이다. 퀄컴은 성능과 에너지 효율, 활용성 모두 향상된 새로운 NPU로 AI PC 이후의 ‘에이전틱 PC’ 시대를 바라본다.

퀄컴은 11월 11~12일 양일간 미국 캘리포니아주 샌디에고의 퀄컴 본사에서 ‘스냅드래곤 X 시리즈 아키텍처 딥다이브 2025’ 행사를 통해 지난 10월 발표한 ‘스냅드래곤 X2 엘리트’ 시리즈의 자세한 기술적 특징을 소개했다.

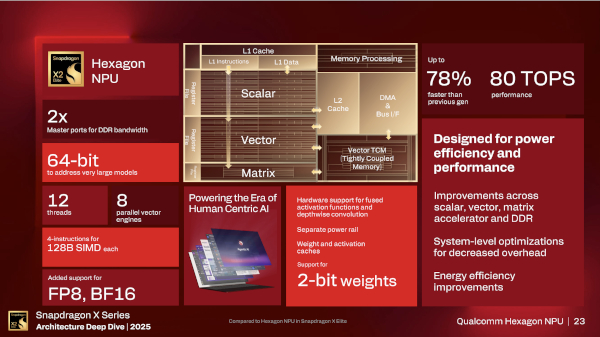

스냅드래곤 X2 엘리트 시리즈에 탑재되는 6세대 헥사곤(Hexagon) NPU는 이전 세대 대비 성능은 최대 78%, 에너지 효율 측면에서는 3~4배 개선됐다. 특히 행렬 연산 성능 뿐만 아니라 스칼라, 벡터, 매트릭스 연산의 균형을 맞춰 다양한 모델 유형에서 효용성을 높인 부분이 눈에 띈다. 퀄컴은 향후 AI PC에서 NPU의 중요성을 강조하며, 더욱 다양한 AI 워크로드에서 NPU를 활용할 수 있도록 생태계 지원을 강화한다는 계획이다.

다중 모델과 에이전틱 AI 시대 대비한 고성능 NPU

루시안 코드레스쿠(Lucian Codrescu) 퀄컴 기술 부사장은 스냅드래곤 X2 시리즈에 탑재된 새로운 NPU에 대해 “이전 세대 대비 큰 업그레이드”라고 평했다. 새로운 6세대 헥사곤 NPU는 이전 세대 대비 78% 향상된 최대 80TOPS 성능을 제공한다. 에너지 효율 측면에서도 3~4배 수준 개선했다. 새로운 NPU는 스냅드래곤 X2 엘리트와 엘리트 익스트림 뿐만 아니라 모든 스냅드래곤 X2 시리즈에 활용될 예정이다.

루시안 코드레스쿠 부사장은 이러한 NPU 성능 강화의 이유로 인공지능(AI)을 제시했다. 그는 “이제 AI는 항상 돌아가고, 여러 애플리케이션에서 여러 개의 모델이 동시에 동작하는 환경을 전제로 해야 한다. 또한 기존의 애플리케이션이 모두 실행되는 환경에 AI가 ‘추가’된 것이고, 제한된 소비전력과 발열 조건에서 성능과 효율, 동시성을 모두 만족해야 한다”고 설명했다.

2004년 처음 선보인 퀄컴의 ‘헥사곤(Hexagon)’은 초기 DSP(Digital Signal Processing)에서 시작해 이제 NPU(Neural Processing Unit)로 발전해 왔다. 초기 헥사곤 DSP는 스칼라(Scalar) 연산 위주 구성이었지만 2014년 헥사곤 ‘프로세서’가 됐을 때는 벡터(Vector) 연산을 위한 요소들이 추가됐고, 2019년 헥사곤 ‘NPU’에서는 전용 행렬 연산 유닛이 추가됐다. 현재의 헥사곤 NPU는 6세대로 분류되며, 퀄컴은 매년 새로운 세대의 NPU를 설계하고 다양한 제품군에 기능과 성능을 조절해 탑재했다.

퀄컴의 NPU는 내부에 스칼라, 벡터, 매트릭스(Matrix) 연산기를 모두 갖추고 있다. 이 중 스칼라 코어는 NPU 전반의 운영과 오케스트레이션을 담당하며, 벡터, 매트릭스 유닛은 작업 특성에 따라 활용된다. 메모리 구조에서는 스칼라와 벡터 유닛이 L2 캐시에, 벡터와 매트릭스 유닛이 온칩 TCM(Tightly Coupled Memory)에 연결돼 있는 모습이다. 퀄컴은 이러한 메모리 연결 구조에 대해 “벡터 및 매트릭스 코어의 동시 활성화 시 필요한 전체 대역폭을 만족할 수 있도록 설계했다”고 언급했다.

스칼라 유닛은 내부적으로 SMT(Simultaneous Multi-Threading)와 VLIW(Very Long Instruction Word)를 결합한 구조를 사용하며, 이전 세대보다 두 배 많은 12쓰레드로 구성했다. 외부 메모리 대역폭 증가에 대응하기 위해 마스터 포트 수를 두 배로 늘렸고, DMA(Direct Memory Access) 아키텍처에 64비트 주소 공간 지원을 추가해 더 큰 데이터들을 나누는 작업 없이 한 번에 다룰 수 있게 했다. 이러한 변화로 스칼라 처리량은 이전보다 143%, 버스 대역폭은 128% 향상됐다.

벡터 유닛은 HVX(Hexagon Vector eXtension) 구조를 사용하며, 기본 1024비트 폭 레지스터를 4-와이드(wide) VLIW로 묶고 8개의 엔진에 걸쳐 배치한 구성이다. 퀄컴은 이번 세대 벡터 유닛의 특징으로 저정밀 데이터 형식에 대한 지원을 강화했고, 전 세대 대비 벡터 처리량은 143% 높였다고 소개했다.

행렬 연산에 특화된 매트릭스 유닛에서 주목할 만한 부분은 ‘2비트 가중치(weight)’를 포함한 다양한 데이터 타입 지원 확대다. 퀄컴은 매트릭스 유닛의 성능, 효율 극대화를 위해서는 MAC 유닛 배열만 키워서는 안된다며 MAC 연산 이후 결과값에 바로 활성 함수 연산을 처리할 수 있는 파이프라인을 넣어 데이터를 다른 유닛으로 옮기지 않고도 추가 처리를 할 수 있게 했다. 이 외에도 매트릭스 유닛의 동작 속도, 전압 관리를 다른 유닛과 분리해 효율성을 높였다. 이전 세대 대비 성능은 78% 높아졌다고 언급됐다.

한편 루시안 코드레스쿠 부사장은 “실제 모델에서는 매트릭스 유닛만 크다고 성능이 잘 나오지 않는다. 시스템 전반의 밸런스를 맞추지 않으면 매트릭스 유닛 크기를 키워도 성능 향상은 제한적이다”라고 지적했다. 또한 데이터 타입과 에너지 효율 측면에서는 “업계 전체가 데이터 정밀도를 낮게 가져가는 방향으로 움직이고 있다”며 “허용 가능한 정확도를 유지하는 선에서 데이터 정밀도를 최대한 낮추는 것이 에너지 효율 상 가장 이득이 크다”고 덧붙였다.

‘에이전틱 AI PC’ 현실화 위한 아키텍처 구현

우펜드라 쿨카르니(Upendra Kulkarni) 퀄컴 제품 관리 부사장은 ‘스냅드래곤 X2’ 시스템온칩(SoC)을 위한 AI 생태계에 대해 소개하며 “퀄컴은 현재 AI 소프트웨어 생태계 전반에 걸쳐 마이크로소프트, 소프트웨어 개발사(ISV)들과 긴밀히 협력하며 클라우드 중심의 AI를 점점 엣지와 PC로 옮기는 역할을 하고 있다”고 언급했다. 또한 “PC에서 AI 실행을 위한 CPU, GPU, NPU의 특성과 역할은 모두 다르다”며 “AI PC에서는 NPU가 핵심 엔진이 될 것”이라 제시했다.

퀄컴은 이 자리에서 UL 프로시온(Procyon)의 AI 컴퓨터 비전 테스트 결과를 인용해 스냅드래곤 X2 엘리트 익스트림에 탑재된 80TOPS 성능의 NPU가 이전 세대 대비로는 78%, 경쟁 제품 대비로는 두 배 이상, 경쟁사의 프로세서 내장 GPU와 비교해도 크게는 3.4배까지 높은 성능을 제공한다고 제시했다. 또한 에너지 효율에서도 경쟁사의 NPU 대비로는 최대 3.8배, 경쟁사의 프로세서 내장 GPU 대비로는 최대 3.7배 높은 효율을 제공한다고 언급했다.

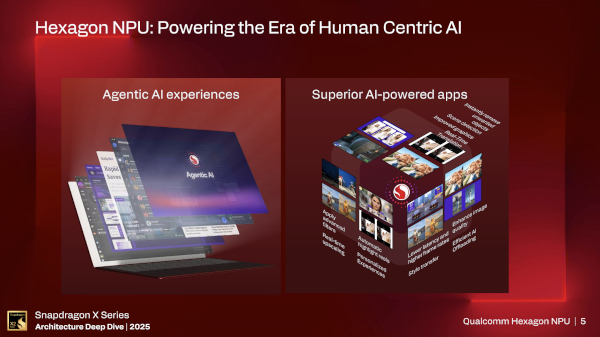

PC에서의 AI 워크로드는 이제 인식에서 생성을 넘어 ‘에이전틱’으로 향하고 있다. 기존 작업 또한 다뤄야 할 작업의 크기가 늘고 있고, 에이전틱 AI 시대에는 사용자의 지시에 따라 여러 모델이 동시에 구동되면서 협력하는 구조다. 우펜드라 쿨카르니 부사장은 “여러 개의 거대언어모델(LLM)과 에이전트가 동시에 작동하며 즉시 응답하기 위해서는 지금보다 더 높은 100~300TOPS급 NPU가 필요할 것”이라며 “에이전트들은 PC 사용 중 백그라운드에 상시 동작하는 만큼 초저전력 NPU 설계가 필수적이다”라고 말했다.

현재 퀄컴의 AI 환경 구성은 크게 마이크로소프트의 ‘윈도ML’과 퀄컴의 ‘AI 엔진 다이렉트(QNN)’ 지원을 사용할 수 있다. 개발자는 이러한 프레임워크와 연결된 파이토치(PyTorch)나 텐서플로우(TensorFlow), 윈도 AI 파운드리(Windows AI Foundry) 등을 활용해 저수준 하드웨어로의 직접 접근 없이도 스냅드래곤 X2 기반 PC의 AI 성능을 활용할 수 있는 구조다. 우펜드라 쿨카르니 부사장은 “개발사가 애플리케이션을 두 번 최적화할 필요 없이 어떤 방법으로든 아키텍처의 최대 성능을 활용할 수 있게 하는 것이 목표다”라고 덧붙였다.

스냅드래곤 기반 윈도 환경의 개발자를 위한 지원 측면에서는 개발자를 위한 도구들, 퀄컴의 칩에 최적화된 모델을 제공하는 AI 허브 등이 소개됐다. 이를 통해 개발자들이 앱 개발과 모델 튜닝을 분리해 진행 가능한 환경을 제공한다. 스냅드래곤 기반 윈도 환경에서는 퀄컴이 제공하는 GPU, NPU 드라이버를 시스템 제조사의 지원을 기다리지 않고 바로 적용할 수도 있다.

AI 애플리케이션과 모델 지원에서도 컴퓨터 비전과 생성형 AI, 에이전틱 AI에 이르기까지 폭넓은 영역에 걸쳐 1000개 이상 모델과 300개 이상 기능들, 100개 이상 앱들을 지원하고 있다고 제시됐다. 여기에는 잘 알려진 거대언어모델들을 직접 실행하는 것뿐만 아니라 일상 생활에 많이 사용되는 애플리케이션들에 적용된 AI 기능을 지원하는 것들도 포함된다. 대표적으로는 어도비 프리미어 프로에 AI로 프레임을 생성하거나 어피니티 포토에서 AI를 활용한 개체 선택 기능, 콘텍스트(Context)의 에이전틱 AI 기반 문서 생성 등이다.

샌디에고=권용만 기자

yongman.kwon@chosunbiz.com

- “게이밍 한계 돌파”… ‘스냅드래곤 X2’, 게임 호환성 대폭 개선 [스냅드래곤 X2]

- 이름 빼고 다 바꾼 3세대 오라이온 코어, 이전 대비 성능 39% 높여 [스냅드래곤 X2]

- “인텔·AMD 넘어섰다”… 퀄컴 ‘X2 엘리트’로 AI PC 판 흔든다 [스냅드래곤 X2]

- “매트릭스 코어, CPU ISA에 통합 구현… 벡터 엔진은 지금이 최적” [스냅드래곤 X2]

- “PC 여전히 진화 중… 새로운 경험이 변화 만들 것” [스냅드래곤 X2]

- "X2 엘리트, 고성능·고효율 혼합 코어로 AI·워크스테이션 공략"[퀄컴 서밋 2025]

- 퀄컴·휴메인, AI PC로 ‘에이전틱 컴퓨팅’ 동맹 선언[퀄컴 서밋 2025]

- “산업 다시 바꿀 혁명”…스냅드래곤 X2 엘리트, PC 경험 새역사 쓴다[퀄컴 서밋 2025]

- “스마트폰·PC 새 기준”…스냅드래곤8 엘리트 5세대·X2 엘리트 공개[퀄컴 서밋 2025]

- 경량 PC서 초고성능 AI 경험…퀄컴, 스냅드래곤 X2 엘리트 익스트림 선봬 [퀄컴 서밋 2025]

- 아몬 퀄컴 CEO “AI 에이전트 중심 생태계 전환, 스냅드래곤이 구현”[퀄컴 서밋 2025]

- “지포스 RTX 5060을 10만원에” [PC마켓]

- “포트나이트도 OK” 게이밍 성능 강화한 퀄컴 ‘X2 엘리트’ 노트북 [스냅드래곤 X2]